华为云AI系统创新Lab论文Poisoner被国际顶级会议ACM MM录用

华为云AI系统创新Lab论文Poisoner被国际顶级会议ACM MM录用

活动对象:华为云电销客户及渠道伙伴客户可参与消费满送活动,其他客户参与前请咨询客户经理

活动时间: 2020年8月12日-2020年9月11日

活动期间,华为云用户通过活动页面购买云服务,或使用上云礼包优惠券在华为云官网新购云服务,累计新购实付付费金额达到一定额度,可兑换相应的实物礼品。活动优惠券可在本活动页面中“上云礼包”等方式获取,在华为云官网直接购买(未使用年中云钜惠活动优惠券)或参与其他活动的订单付费金额不计入统计范围内;

活动对象:华为云电销客户及渠道伙伴客户可参与消费满送活动,其他客户参与前请咨询客户经理

2024年7月16日,多媒体领域国际顶级会议ACM MM 2024公布了录用论文结果。华为云AI系统创新Lab作为第一单位的研究论文《Poisoning for Debiasing: Fair Recognition via Eliminating Bias Uncovered in Data Poisoning》被ACM MM主会接收。ACM MM是多媒体领域最受关注的国际学术会议之一,属于CCF A类,对发表的文章有着严格的评审标准,以确保所发表的研究成果具有较高的学术价值、原创性和影响力。ACM MM 2024 将于2024年10月28日至11月1日在澳大利亚墨尔本召开。论文主要内容如下:

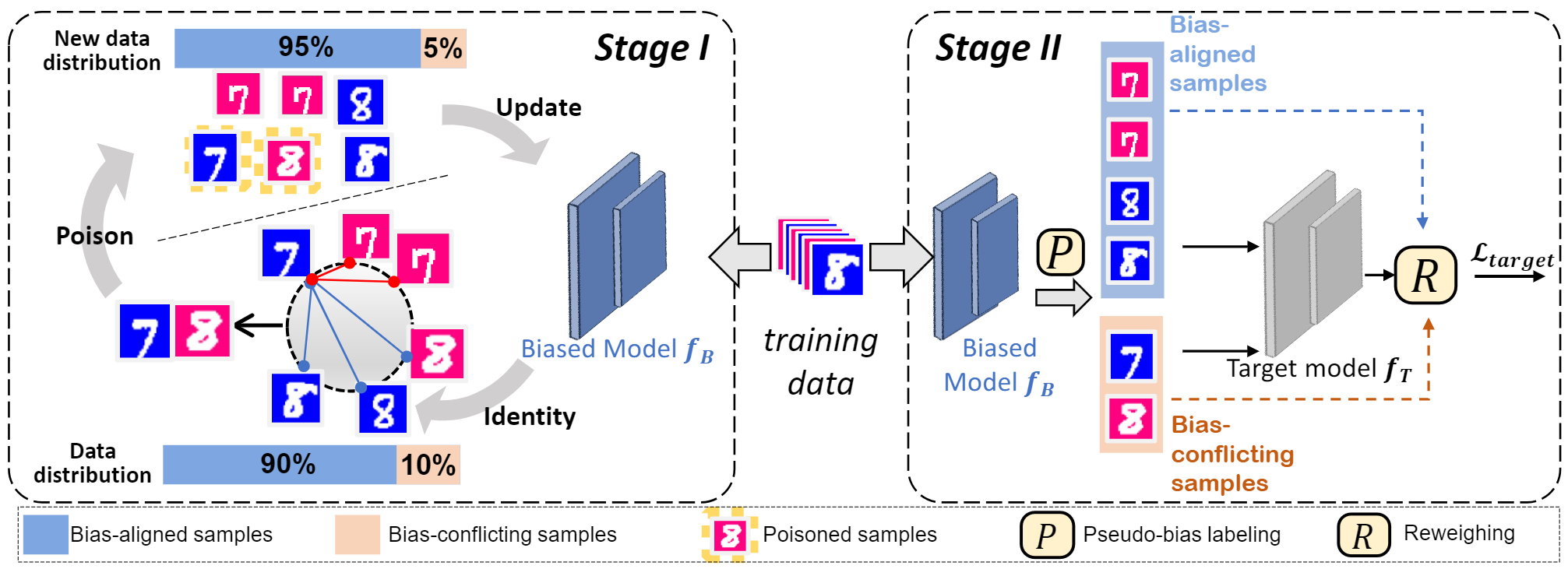

近些年来,深度学习已经在包括语音识别、图像分类和智能对话等多种应用场景下展示出了超越人类的表现。但是一个挑战至今未被解决:神经网络在决策过程中常常依赖于与目标标签具有强烈但虚假的相关性的偏见特征,从而导致神经网络的决策规则偏离人类的建模初衷。早期的去偏见方法尝试通过基于偏见特征标签构建无偏优化目标来解决这个问题,但这种标签的标注过程既困难又耗时。针对这一问题,《Poisoning for Debiasing: Fair Recognition via Eliminating Bias Uncovered in Data Poisoning》提出了一种创新的去偏见方法—“poisoner”。这种方法利用数据投毒将偏见模型学习到的偏见进一步以数据投毒的形式保存为被投毒的训练数据,从而促使模型学习更多的偏见。通过这种方式,模型可以潜在地为偏见特征进行自动化地标注,即识别出数据中与这些虚假相关性相矛盾的样本。随后,在目标模型的训练过程中,放大这些样本的影响,阻止模型学习这种虚假相关性而只学习人类期待模型建模的相关性。大量实验结果表明,该方法在去偏见方面表现出色,显著优于现有方法。