数据治理中心 DATAARTS STUDIO-Apache Kafka同步到MRS Kafka:操作步骤

操作步骤

本小节以Apache Kafka到 MRS Kafka实时同步为示例,介绍如何配置Migration实时集成作业。配置作业前请务必阅读使用前自检概览, 确认已做好所有准备工作。

- 参见新建实时集成作业创建一个实时集成作业并进入作业配置界面。

- 选择数据连接类型:源端选Apache_Kafka,目的端选MRS_Kafka。

图1 选择数据连接类型

- 选择集成作业类型:同步类型默认为实时,同步场景仅支持整库场景。

图2 选择集成作业类型

- 配置网络资源:选择已创建的DMS Kafka、OBS数据连接和已配置好网络连接的资源组。

图3 选择数据连接及资源组

- 检测网络连通性:数据连接和资源组配置完成后需要测试整个迁移任务的网络连通性,可通过以下方式进行数据源和资源组之间的连通性测试。

- 单击展开“源端配置”触发连通性测试,会对整个迁移任务的连通性做校验。

- 单击源端和目的端数据源和资源组中的“测试”按钮进行检测。

- 配置源端参数。

- 配置目的端参数。

图5 Kafka目的端配置项

- 目标Topic名称规则。

配置源端MySQL库表与目的端Kafka Topic的映射规则。可指定为固定的一个Topic,也可使用内置变量做映射,将不同源表数据同步到不同的Topic中。

可以使用的内置变量有:源Topic名:#{source_Topic_name}

- 同步kafka partition策略

- 新建Topic的Partition数量

- Kafka目标端属性配置

支持设置Kafka的配置项,需要增加 properties. 前缀,作业将自动移除前缀并传入底层Kafka客户端,具体参数可参考Apache Kafka官方文档中的配置说明。

- 目标Topic名称规则。

- 刷新源表和目标表映射,检查源端Topic和目的端Topic映射关系是否正确,支持用户根据实际需求修改映射后的目的端Topic名称,可以配置为一对一、多对一的映射关系。

图6 源表与目标表映射

- 配置任务属性。

表5 任务配置参数说明 参数

说明

默认值

执行内存

作业执行分配内存,跟随处理器核数变化而自动变化。

8GB

处理器核数

范围:2-32。

每增加1处理核数,则自动增加4G执行内存和1并发数。

2

并发数

作业执行支持并发数。该参数无需配置,跟随处理器核数变化而自动变化。

1

自动重试

作业失败时是否开启自动重试。

否

最大重试次数

“自动重试”为是时显示该参数。

1

重试间隔时间

“自动重试”为是时显示该参数。

120秒

是否写入脏数据

选择是否记录脏数据,默认不记录脏数据,当脏数据过多时,会影响同步任务的整体同步速度。

链路是否支持写入脏数据,以实际界面为准。

- 否:默认为否,不记录脏数据。

- 是:允许脏数据,即任务产生脏数据时不影响任务执行。

允许脏数据并设置其阈值时:

- 若产生的脏数据在阈值范围内,同步任务将忽略脏数据(即不会写入目标端),并正常执行。

- 若产生的脏数据超出阈值范围,同步任务将失败退出。

说明:

脏数据认定标准:脏数据是对业务没有意义,格式非法或者同步过程中出现问题的数据;单条数据写入目标数据源过程中发生了异常,则此条数据为脏数据。 因此只要是写入失败的数据均被归类于脏数据。

例如,源端是VARCHAR类型的数据写到INT类型的目标列中,则会因为转换不合理导致脏数据不会成功写入目的端。用户可以在同步任务配置时,配置同步过程中是否写入脏数据,配置脏数据条数(单个分片的最大错误记录数)保证任务运行,即当脏数据超过指定条数时,任务失败退出。

否

脏数据策略

“是否写入脏数据”为是时显示该参数,当前支持以下策略:

- 不归档:不对脏数据进行存储,仅记录到任务日志中。

- 归档到OBS:将脏数据存储到OBS中,并打印到任务日志中。

不归档

脏数据写入连接

“脏数据策略”选择归档到OBS时显示该参数。

脏数据要写入的连接,目前只支持写入到OBS连接。

-

脏数据目录

脏数据写入的OBS目录。

-

脏数据阈值

是否写入脏数据为是时显示该参数。

用户根据实际设置脏数据阈值。

说明:- 脏数据阈值仅针对每个并发生效。比如阈值为100,并发为3,则该作业可容忍的脏数据条数最多为300。

- 输入-1表示不限制脏数据条数

100

添加自定义属性

支持通过自定义属性修改部分作业参数及开启部分高级功能,详情可参见任务性能调优章节。

-

- 提交并运行任务。

作业配置完毕后,单击作业开发页面左上角“提交”,完成作业提交。

图7 提交作业

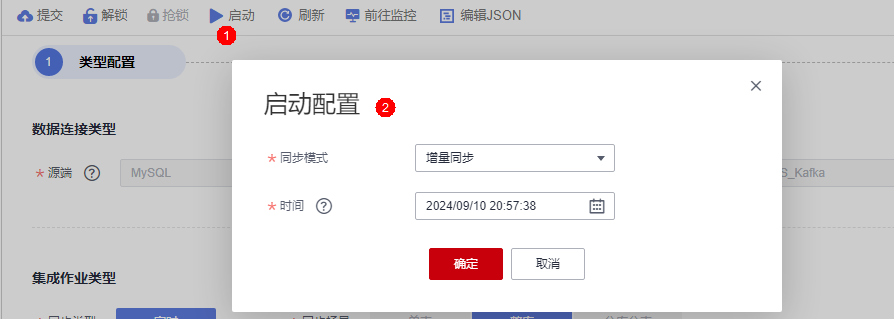

提交成功后,单击作业开发页面左上角“启动”按钮,在弹出的启动配置对话框按照实际情况配置同步位点参数,单击“确定”启动作业。

图8 启动配置

表6 启动配置参数 参数

说明

同步模式

- 最早:从Kafka Topic最早偏移量开始消费数据。

- 最新:从Kafka Topic最新偏移量开始消费数据。

- 起止时间:根据时间获取Kafka Topic对应的偏移量,并从该偏移量开始消费数据。

时间

起止时间需要设置该参数,指示同步起始的时间位点。

说明:配置的位点时间早于Kafka消息最早偏移量时,默认会从最早偏移量开始消费。

- 监控作业。

通过单击作业开发页面导航栏的“前往监控”按钮,可前往作业监控页面查看运行情况、监控日志等信息,并配置对应的告警规则,详情请参见实时集成任务运维。

图9 前往监控

- 数据治理中心_数据开发_数据开发能力_脚本和节点介绍-华为云

- kafka是什么_kafka介绍_分布式消息服务Kafka版

- Kafka架构_Kafka如何实现负载均衡_Kafka数据存储方式-华为云

- 大数据分析是什么_使用MapReduce_创建MRS服务

- MapReduce工作原理_MapReduce是什么意思_MapReduce流程_MRS_华为云

- MapReduce服务_什么是Kafka_如何使用Kafka

- 数据治理中心_数据质量评估_质量规则和质量报告-华为云

- 分布式消息服务Kafka版与分布式消息服务RocketMQ版的区别_Kafka与RocketMQ对比_Kafka与RocketMQ差异

- 数据治理中心_数据开发_最佳实践_-华为云

- MRS优势_什么是MRS_MRS功能

下载数据治理中心 DATAARTS STUDIO用户手册完整版

下载数据治理中心 DATAARTS STUDIO用户手册完整版